2026.3.12

本研究提出了一种创新的SAM驱动双Swin Transformer网络SAM-Swin,通过整合SAM2引导的病灶定位、多尺度病灶感知增强模块和多尺度类感知指导损失,实现了对喉咽部肿瘤的高精度检测和分类,并在三个临床数据集上显著优于现有先进方法,为早期LPC诊断提供了强大的自动化工具。

Title题目

01

SAM-Swin: SAM-driven dual-swin transformers with adaptive lesion enhancement for Laryngo-Pharyngeal tumor detection

SAM-Swin:SAM驱动的双Swin Transformer与自适应病灶增强用于喉咽部肿瘤检测

文献速递介绍

02

喉咽癌(LPC)占上呼吸道癌症的65%至70%,在晚期常需全喉切除术,严重影响患者生活质量。早期LPC通过微创手术治疗,五年生存率可达90%,因此早期准确诊断至关重要。目前诊断金标准是电子喉镜下活检,但受内镜医生技能经验限制,存在漏诊和不必要重复活检。自动检测方法对辅助诊断意义重大。现有深度学习方法分为单分支和双分支网络。单分支网络(如U-Net、DeepLab)擅长提取全局特征,但忽略了病灶区域重要的局部信息。双分支网络(如ELNet、DLGNet)旨在结合全局和局部特征,但仍存在病灶精确定位挑战以及简单特征拼接未能充分利用互补性的问题。为解决这些局限性,本研究提出了SAM-Swin,一种由Segment Anything Model 2(SAM2)增强的创新双Swin Transformer框架,用于喉咽部肿瘤检测,并引入了多尺度病灶感知增强模块(MS-LAEM)和多尺度类感知指导(CAG)损失功能,以提升模型性能和判别能力。实验证明SAM-Swin优于现有最先进的基线方法,对之前模型进行了关键架构增强,包括升级SAM到SAM2、Swin Transformer骨干网络到Swin Transformer 2,并增加了MS-LAEM和CAG损失。

Aastract摘要

02

喉咽癌(LPC)是头颈部区域一种高度致命的恶性肿瘤。尽管双分支网络架构在肿瘤检测方面取得了进展,但仍面临病灶准确定位和充分利用分支间互补特征的挑战。为解决这些问题,我们提出了一种创新的SAM驱动双Swin Transformer(SAM-Swin)模型,用于喉咽部肿瘤检测。该模型利用Segment Anything Model 2(SAM2)强大的分割能力实现精确的病灶分割。同时,我们引入了一个多尺度病灶感知增强模块(MS-LAEM),旨在自适应地增强不同尺度上细微互补特征的学习,从而提高特征提取和表示的质量。此外,我们还采用了多尺度类感知指导(CAG)损失,提供多尺度靶向监督,增强模型提取类特异性特征的能力。为了验证我们方法的有效性,我们从中山大学附属第一医院(FAHSYSU)、中山大学附属第六医院(SAHSYSU)和南方医科大学南方医院(NHSMU)收集了三个LPC数据集。FAHSYSU数据集用于内部训练,而SAHSYSU和NHSMU数据集用于外部评估。广泛的实验结果表明,SAM-Swin的性能优于现有最先进的方法,展示了其在推进LPC检测和改善患者预后方面的巨大潜力。

Method方法

03

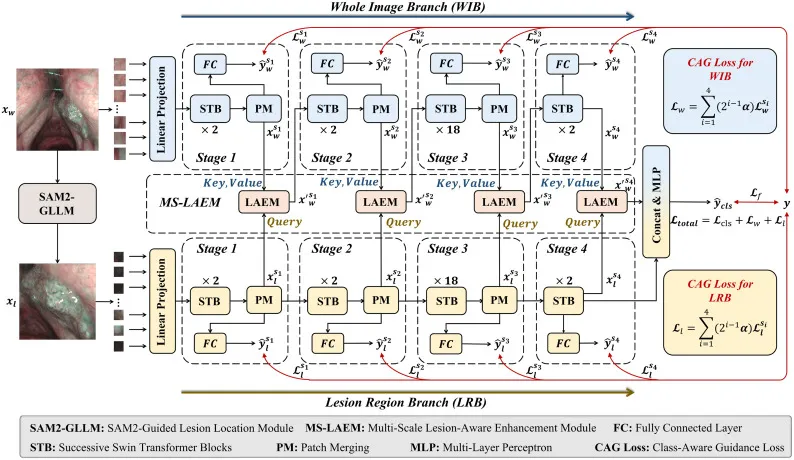

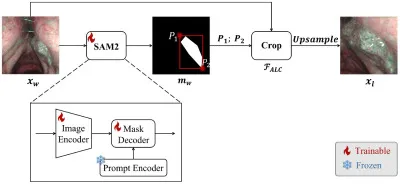

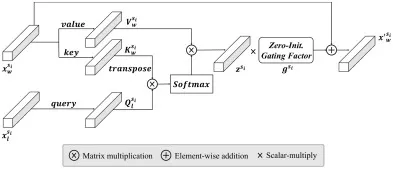

本文提出的SAM-Swin是一种新颖的SAM驱动双Swin Transformer架构,具有自适应病灶增强功能,专为喉咽部肿瘤检测设计。其框架主要由四个关键组件构成:SAM2引导的病灶定位模块(SAM2-GLLM)、全图像分支(WIB)、病灶区域分支(LRB)和多尺度病灶感知增强模块(MS-LAEM)。为进一步提升模型性能,SAM-Swin在WIB和LRB模块中整合了多尺度CAG损失,并在最终输出应用了交叉熵损失。SAM2-GLLM利用经过非PEFT微调的SAM2实现高精度的病灶掩膜生成。它在“无提示”自动分割模式下运行,将多个检测到的区域统一为一个掩膜,并通过自适应裁剪策略生成病灶区域图像,确保捕获完整病灶及周围上下文。WIB通过Swin Transformer 2骨干网络处理整个图像,以捕捉全局上下文理解和生成层次化特征,通过线性嵌入层和四阶段处理生成多尺度特征金字塔。LRB采用与WIB相同的架构,但不共享权重,以从不同视角学习病灶特异性信息,同样通过四阶段处理生成多尺度特征。MS-LAEM通过多头注意力机制,将病灶区域的查询令牌与全图像的键和值令牌进行融合,生成更丰富的病灶特异性特征,并利用一个可学习的、零初始化的门控因子自适应地调整病灶特征的重要性,然后与原始全图像令牌结合以产生增强的特征表示。目标损失函数包括基于WIB和LRB的多尺度CAG损失(通过指数加权强调深层特征),以及最终分类阶段的交叉熵损失,旨在平衡不同学习过程的贡献,确保鲁棒的检测和分类。

Discussion讨论

04

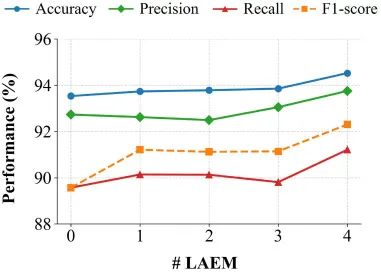

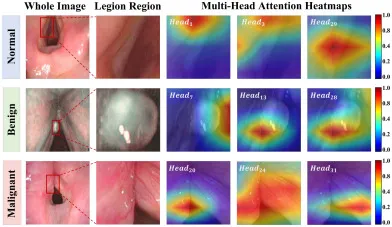

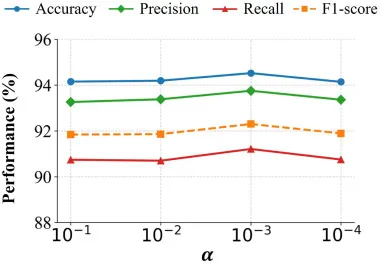

本文通过消融实验详细评估了SAM-Swin各组件的贡献。实验结果表明,单独使用WIB模型可提供基线性能,而LRB模块虽然单独使用时性能略有下降,但在与WIB结合(M3)后,模型性能得到显著提升。MS-LAEM模块(M4)的引入进一步增强了模型自适应学习多尺度特征的能力,最终完整的SAM-Swin(M5)模型在所有性能指标上均表现最佳,尤其在良性和恶性类别的召回率方面提升显著。t-SNE可视化也清晰显示,随着模型组件的逐步集成,类别分离度不断提高,最终SAM-Swin实现了最佳的类间区分。对SAM2-GLLM的分析显示,SAM2在平均IoU和Dice分数上均优于UNet、Mask-RCNN和SAM,尤其在良性病灶分割方面表现出显著优势,证实了其在提高病灶定位精度上的有效性。WIB和LRB的交互作用通过Grad-CAM可视化得到阐明:WIB进行粗略的全局定位,而LRB在此基础上进行精细化和强化,实现对病灶区域的精确聚焦。MS-LAEM的影响研究发现,随着LAEM数量的增加,模型的召回率、F1-score和准确率持续提升,最多引入4个LAEM时达到最佳性能。多头病灶感知注意力图显示LAEM能够使不同注意力头聚焦于病灶区域的不同部分,捕获多样化的上下文信息。超参数调优结果显示,CAG损失权重alpha为10^-3时模型性能最佳,实现了类特异性监督和整体性能之间的平衡。计算复杂度分析表明,SAM-Swin在实现最先进F1-score的同时,参数效率和计算经济性也优于多数现有方法,推理延迟低至45.40毫秒,具备实时临床部署潜力。故障案例分析揭示了模型的主要局限性,包括噪声引起的定位错误(如唾液被误判为病灶)、高度细微病灶(低对比度导致假阴性)以及特征模糊的临界病例(如良性病灶呈现恶性特征导致误分类)。这些发现为未来的数据增强策略和更精细的特征学习机制指明了方向。

Conclusion结论

05

本研究提出了一种新颖的SAM驱动双Swin Transformer框架SAM-Swin,并集成了自适应病灶增强机制,专为喉咽部肿瘤检测设计。该框架主要由SAM2-GLLM、WIB、LRB和MS-LAEM四个关键组件构成。此外,我们引入了多尺度类感知指导(CAG)损失函数,旨在提供类特异性监督,从而提升模型区分不同肿瘤类别的能力。在FAHSYSU、SAHSYSU和NHSMU三个不同数据集(包括内部和外部来源)上进行的全面实验表明,SAM-Swin模型表现出卓越的有效性,在FAHSYSU、SAHSYSU和NHSMU上的整体准确率分别达到94.52%、91.28%和93.06%。这些结果显著超越了现有喉咽部肿瘤检测的最先进方法。通过Grad-CAM可视化、消融研究和详细的模块有效性分析,进一步验证了我们所提出方法的可靠性和优越性。我们的综合分析强调了SAM-Swin框架作为LPC检测强大工具的潜力,为临床实践中更有效的诊断应用铺平了道路。

Results结果

06

本研究在三个多机构喉镜图像数据集上进行了广泛实验:FAHSYSU(内部训练、验证、测试),SAHSYSU和NHSMU(外部测试)。实验结果显示,SAM-Swin在FAHSYSU数据集上表现最佳,整体准确率达93.79%±0.14%,F1-score达91.23%±0.15%。在外部数据集SAHSYSU和NHSMU上,SAM-Swin也展现了类似的优势,NHSMU数据集上的准确率达到93.55%±0.41%,F1-score为84.35%±1.14%,这证明了模型的鲁棒性和泛化能力。尤其值得注意的是,SAM-Swin在良性和恶性类别的召回率方面表现出色,如FAHSYSU数据集中对恶性病灶的召回率高达97.94%。Grad-CAM可视化分析表明,SAM-Swin模型能够更精确地聚焦于图像中最具判别力的病灶区域,甚至对于微小和浅表肿瘤也能捕获完整的肿瘤区域,包括边界细节和周围组织,从而利用上下文信息实现精细的肿瘤区分,这与其他倾向于关注扩散区域或局部有限区域的基线模型形成对比。此外,SAM2在分割性能比较中,平均IoU和Dice分数均最高,尤其在良性病灶分割方面显著优于其他分割模型,验证了SAM2-GLLM在提高分割精度方面的有效性。消融实验证实了WIB、LRB、MS-LAEM以及CAG损失各自对模型性能的积极贡献,特别是MS-LAEM的逐步引入和CAG损失的优化权重,显著提升了分类性能和类间分离度(通过t-SNE可视化)。

Figure图

07

图1.SAM-Swin的整体架构。SAM-Swin由四个关键部分组成:SAM2引导的病灶定位模块(SAM2-GLLM)、全图像分支(WIB)、病灶区域分支(LRB)和多尺度病灶感知增强模块(MS-LAEM)。

图2.SAM2引导的病灶定位模块(SAM2-GLLM)工作流程图。SAM2-GLLM利用SAM2在全图像xw上的无提示自动分割模式,生成一个或多个病灶掩膜,这些掩膜被统一为一个单一掩膜mw。然后计算一个由P1和P2坐标定义的紧密边界框,以包围所有检测到的病灶区域。为了生成感兴趣区域,我们采用自适应病灶裁剪策略,然后将病灶区域图像xl上采样到与全图像xw相同的大小。

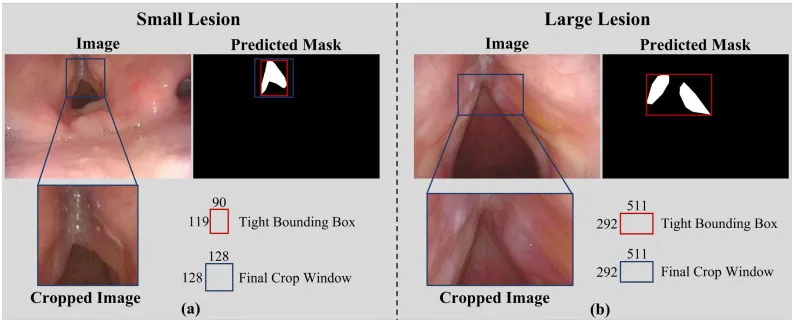

图3.SAM-Swin中自适应裁剪策略的图示。(a) 对于紧密边界框(红线)小于128 × 128的小病灶,裁剪窗口(蓝线)扩展到以病灶为中心的固定大小128 × 128。(b) 对于紧密边界框大于128 × 128的大病灶,边界框本身被用作裁剪窗口,以确保完全覆盖。

图4.病灶感知增强模块(LAEM)的图示。查询令牌从病灶区域令牌生成,而键和值令牌从全图像令牌生成。这些查询、键和值令牌随后通过多头注意力(MHA)处理,以导出增强的特征令牌,其中包含更丰富的病灶特异性特征表示。随后,应用可学习的、零初始化的门控因子乘以增强的特征令牌,自适应地调整病灶特征的重要性。最后,这些增强的特征令牌与原始全图像令牌结合以产生最终令牌。

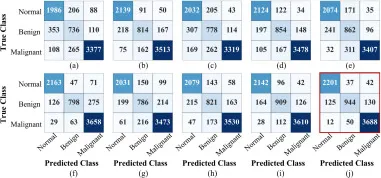

图5.由我们提出的SAM-Swin与其他对比方法在FAHSYSU数据集上获得的混淆矩阵。(a) VGGNet, (b) ResNet, © DenseNet, (d) EfficientNet, (e) ViT, (f) SwinV2, (g) RadFormer, (h) DLGNet, (i) SAM-FNet, (j) SAM-Swin。

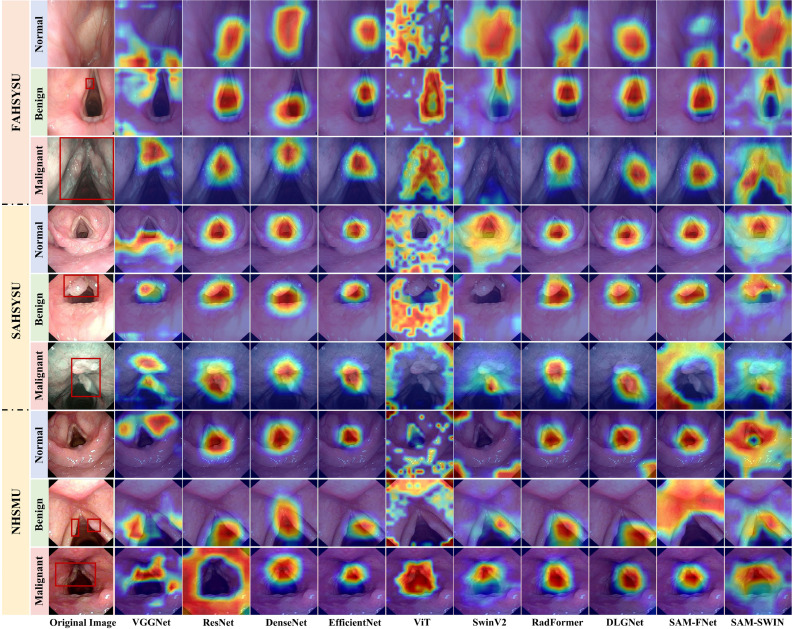

图6.FAHSYSU、SAHSYSU和NHSMU数据集上的Grad-CAM可视化图示。

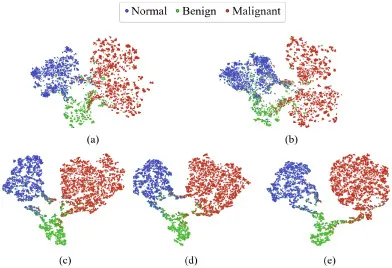

图7.FAHSYSU数据集上消融实验的t-SNE可视化。其中,(a) M1(仅WIB),(b) M2(仅LRB),© M3(WIB+LRB),(d) M4(WIB+LRB+MS-LAEM),(e) M5(SAM-Swin,所有组件)。

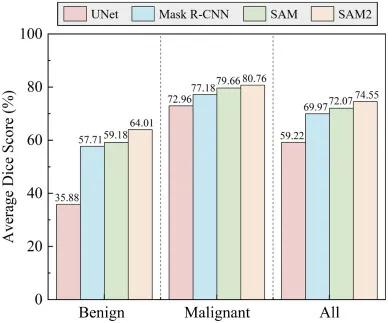

图8.FAHSYSU数据集上不同分割方法在良性、恶性和组合(所有)类别中的平均Dice分数。

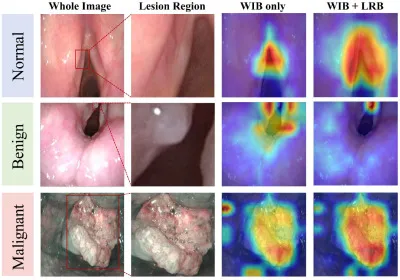

图9.Grad-CAM分析阐明了WIB-LRB的交互作用:在所有类别中,WIB执行粗略的初始定位,然后LRB对其进行细化和强化,以实现对显著区域的精确聚焦。

图10.所提出的SAM-Swin模型在FAHSYSU数据集上,具有不同数量病灶感知增强模块的结果。

图11.第4阶段多头病灶感知注意力图的可视化,说明了不同头部如何聚焦于全图像中病灶区域的不同部分。

图12.SAM-Swin模型在FAHSYSU数据集上,具有不同α值下的类感知指导损失结果。

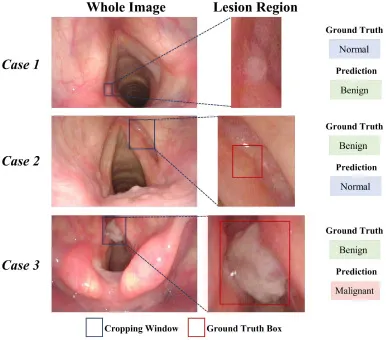

图13我们提出的SAM-Swin的代表性失败案例。(案例1) 假阳性(真实情况:正常,预测:良性),其中唾液被错误地定位为病灶区域。(案例2) 假阴性(真实情况:良性,预测:正常),其中良性病灶过于细微且在视觉上与周围健康组织相似。(案例3) 挑战性临界病例的错误分类(真实情况:良性,预测:恶性),其中良性病灶呈现出高度提示恶性的特征,例如不规则表面。