2026.3.5

本文提出BIASNet,一个用于弱监督医学图像配准的新型网络,通过双属性特征学习、语义引导的渐进式配准和解剖区域形变一致性学习,有效利用分割标签的先验信息,实现了优于现有最先进方法的配准精度和鲁棒性,尤其在大形变场景下表现突出。

Title题目

01

BIASNet: A bidirectional feature alignment and semantics-guided network for weakly-supervised medical image registration

BIASNet:一种用于弱监督医学图像配准的双向特征对齐与语义引导网络

文献速递介绍

02

医学图像配准是医学图像分析中的一项基本任务,旨在建立医学图像对之间的精确空间对应关系。传统的形变配准方法受固定优化范式限制,难以利用高级特征提取和弱监督信息,从而阻碍了配准精度的进一步提升。深度学习通过数据驱动的方法,自动学习分层特征表示,显著推动了医学图像配准的发展。U-Net等架构及其在特征提取和损失函数设计上的改进,以及渐进式配准策略,已在复杂形变场景中展现出优越性能。然而,研究表明,在缺乏弱监督的情况下,学习方法的架构设计对配准精度提升有限。基础分割模型(如TotalSegmentator和SAM)的出现使得获取高质量解剖标签变得容易,从而促进了弱监督配准的发展。目前弱监督配准方法仍存在不足,主要体现在:现有方法多依赖强度特征进行形变预测,这些特征缺乏明确的解剖语义信息,且对噪声和强度对比敏感;现有特征融合方法可能导致跨解码器级别的错位、语义不一致和细节模糊;分割标签主要用于损失计算,缺乏图像空间中显式的解剖信息指导。为解决这些问题,本文提出了BIASNet,一个双向特征对齐与语义引导网络,通过双属性特征表示学习、语义引导的渐进式配准框架和解剖区域形变一致性学习来解决上述挑战,显著提升弱监督医学图像配准的性能。

Aastract摘要

02

医学图像配准在众多临床应用和诊断流程中扮演着基础角色,旨在建立不同医学图像间的空间对应关系。尽管基于无监督深度学习的配准方法取得了显著进展,但其结果仍通常不及弱监督方法。随着通用分割模型的发展,从医学图像中获取解剖标签变得更容易。然而,现有配准方法未能充分利用分割标签提供的丰富解剖和结构先验信息。为解决这一局限性,我们提出了一种名为BIASNet的双向特征对齐和语义引导网络,用于弱监督图像配准。具体来说,我们从经LoRA(低秩适应)微调的预训练VoCo模型中提取多尺度特征,并提出一种双属性学习方案,其中包含一个新颖的双向对齐与融合(BIAF)模块,用于提取语义和强度特征。这两种特征随后被输入到语义引导的渐进式配准框架中,以实现精确的形变场估计。我们进一步提出解剖区域形变一致性学习,以规范目标解剖区域的形变。在三个典型而具有挑战性的数据集上进行的全面实验表明,我们的方法持续优于其他最先进的可形变配准方法。源代码已公开。

Method方法

03

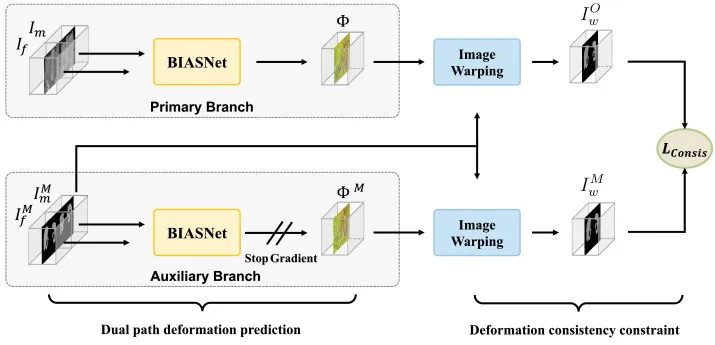

本文提出的BIASNet框架通过三个关键组件增强弱监督医学图像配准:双属性特征表示学习、语义引导的渐进式配准和解剖区域形变一致性学习。首先,双属性特征表示学习利用经过LoRA微调的预训练VoCo模型作为骨干网络提取多尺度特征。随后,设计了双解码器架构,包括语义解码器(Dsem)和强度解码器(Dint),分别提取语义特征和强度特征。其中,Dsem采用级联双解码器设计,以生成适合分割和配准的语义特征。两个解码器都集成了所提出的双向特征对齐与融合(BIAF)模块,该模块通过动态建立跨尺度特征图之间的空间对应关系,解决多尺度特征融合中的错位问题,实现精确的特征融合。其次,语义引导的渐进式配准从最低分辨率层开始分层操作。在每个分辨率级别,通过混合注意力校准(MAC)模块利用强度特征增强语义特征,生成丰富的特征表示,兼顾局部细节和语义信息。这些增强特征用于估计残差形变场,并与前一分辨率累积的形变场融合,逐步细化至最高分辨率,最终输出形变场。最后,解剖区域形变一致性学习(ARDC) 策略引入辅助形变场预测路径,并行处理掩膜版本的输入图像,并在图像级别施加一致性约束,以促进解剖区域内形变图像的一致性,从而提高配准精度。该策略通过抑制非解剖区域强度来集中网络对器官边界和结构的关注。整个网络在训练时采用包含图像相似性、形变场平滑、形变场正则化、弱监督Dice、分割任务监督和解剖一致性等多种损失的综合损失函数进行优化。在推理阶段,BIASNet无需分割标签或手动标注即可直接预测形变场。

Discussion讨论

04

医学图像配准在多种临床图像引导程序中至关重要。尽管现有方法取得了显著进展,但它们往往未能充分利用分割标签中蕴含的丰富先验信息。BIASNet通过双向特征对齐和语义引导网络,有效利用了分割标签中未充分开发的潜力,在三个具有挑战性的数据集上进行了广泛实验,证明其性能优于最先进的配准方法。BIASNet的卓越性能源于其三大核心组件:双属性特征表示学习、语义引导的渐进式配准以及解剖区域形变一致性学习。与现有主要通过配准任务监督优化特征的方法不同,BIASNet明确利用由分割任务监督学习到的语义特征来估计形变场,并通过MAC模块增强这些语义特征。针对传统插值上采样和跳跃连接在多尺度特征融合中固有的信息丢失问题,BIASNet的BIAF模块通过双向跨尺度特征对齐和融合,动态建立特征图之间的跨尺度位置对应关系。此外,解剖区域形变一致性学习策略在图像和标签层面提供了更全面的监督,有效利用了分割标签中的先验信息。与之前的粗到精渐进式配准方法相比,BIASNet在每个分辨率级别上利用解剖感知的语义特征进行形变场估计,并通过MAC模块校准,从而在渐进式配准过程中捕获全局和细粒度的解剖关系,实现了卓越性能。BIASNet的局限性包括训练时仍依赖分割标签,尽管测试时无需;自动生成标签可能导致性能略有下降,需要开发噪声鲁棒的训练策略;以及超参数的经验性确定。然而,即使存在这些限制,BIASNet在所有三个数据集上仍持续优于其他SOTA方法,并且即使使用自动生成标签进行训练,其性能仍优于使用真实标签训练的最优对比方法,这预示着其在未来临床应用中的巨大潜力。

Conclusion结论

05

本文提出了一种用于弱监督图像配准的新型双向特征对齐和语义引导网络,命名为BIASNet。该网络采用经过低秩适应(LoRA)微调的VoCo进行高效特征提取,并设计了双属性特征解码架构,用于同时提取语义特征和强度特征。提取出的特征随后被送入语义引导的渐进式配准框架。为解决渐进式配准中重复上采样操作和跳跃连接可能导致的特征错位问题,本文提出了双向对齐与融合(BIAF)模块,实现了精确的双向跨尺度特征对齐与融合。考虑到语义特征在配准性能上优于强度特征的实证发现,我们设计了混合注意力校准(MAC)模块,明确利用强度特征来增强语义特征。增强后的表示随后在渐进式配准范式中被利用,以预测多分辨率形变场并输出最高分辨率的形变场。为进一步挖掘分割标签中的先验信息,我们引入了解剖区域形变一致性学习策略,以提供额外的基于标签的监督信号。在三个典型且具有挑战性的数据集上的实验验证了BIASNet优于其他最先进方法的卓越性能。

Results结果

06

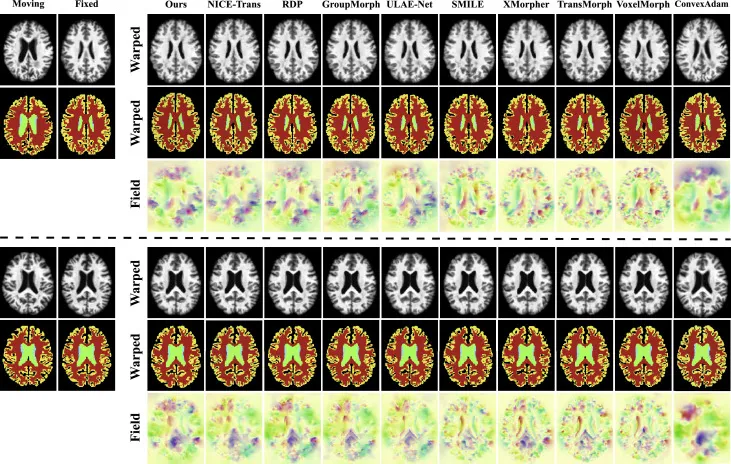

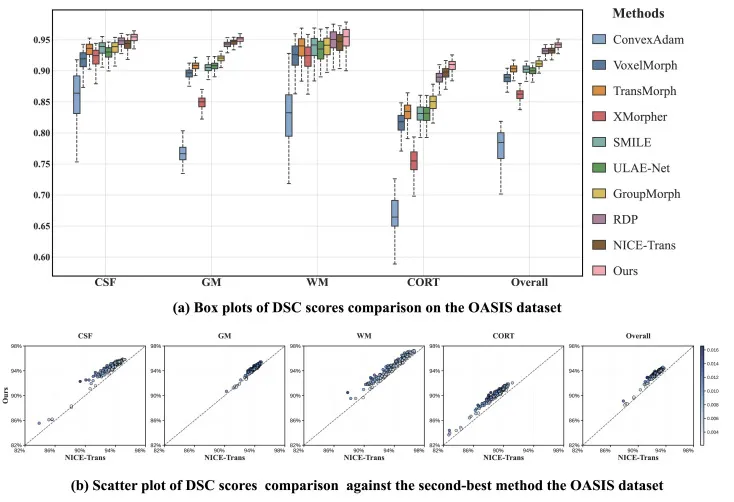

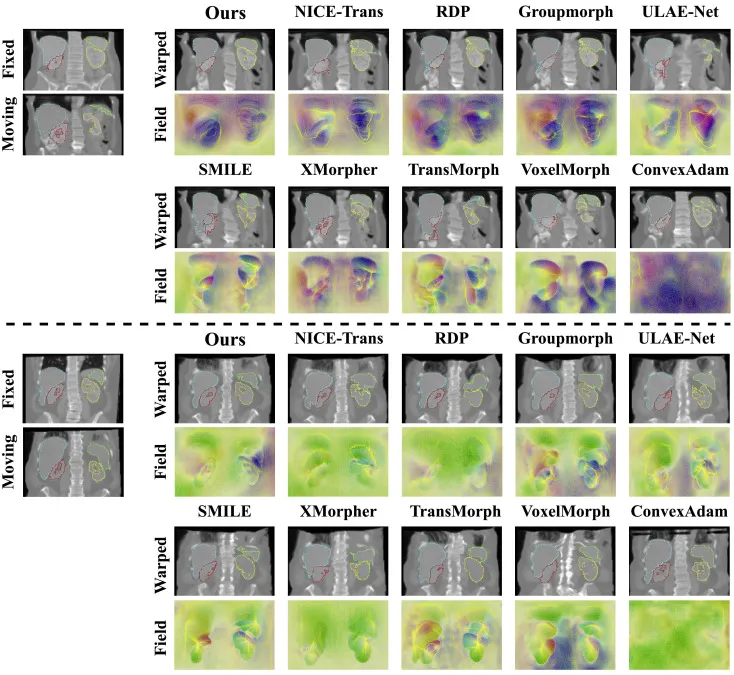

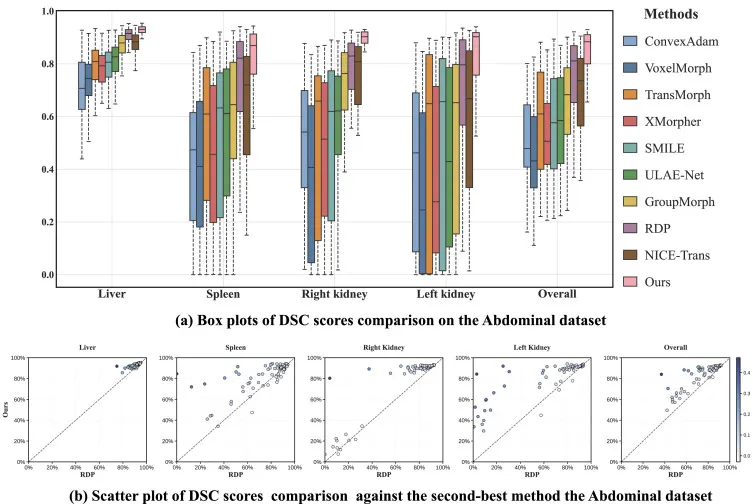

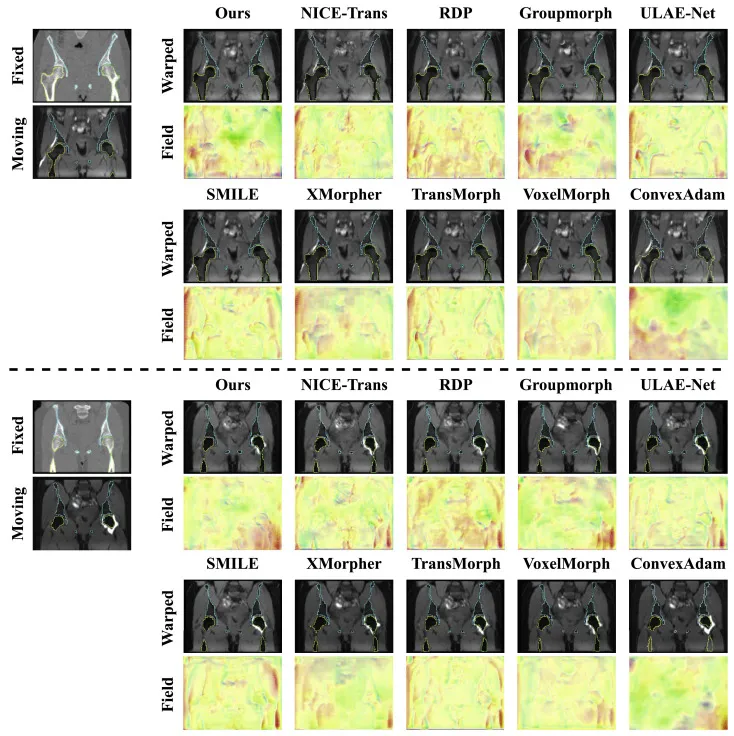

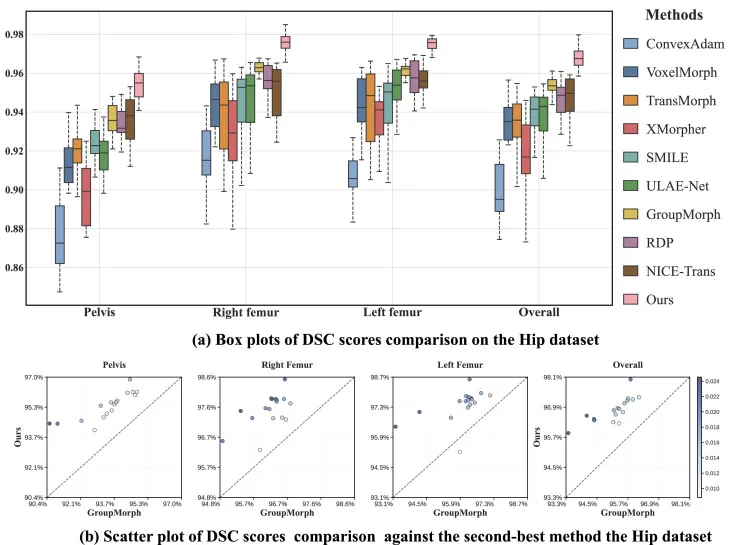

本文在OASIS(脑部T1加权MR)、腹部(CT)和髋关节(CT-MR跨模态)三个具有挑战性的数据集上进行了全面实验。定量结果显示,BIASNet在配准精度方面始终优于现有最先进的方法。在OASIS数据集上,BIASNet的平均DSC达到94.01%,折叠率低至3.83e-2%,显著优于NICE-Trans(93.11%)和RDP(93.06%)。定性结果(图6)和详细分析(图7)进一步验证了其在所有解剖结构上的卓越性能。在腹部数据集上,BIASNet平均DSC为83.41%,折叠率为1.76e-1%,远超第二名RDP(74.61%),显示了其在大形变场景下的强大能力。定性结果(图8)和详细分析(图9)也支持了这一结论。在髋关节数据集的跨模态配准任务中,BIASNet的平均DSC为96.78%,折叠率4.11e-3%,同样优于GroupMorph(95.18%)等方法,定性结果(图10)和详细分析(图11)证实了其优势。

Figure图

07

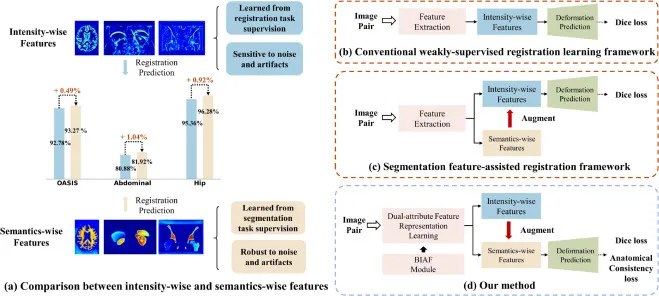

图1. 所提出方法的概念设计。(a) 一项实证研究(详情将在4.6.3节介绍)的结果,比较了在三个数据集上强度特征与语义特征在形变预测性能(以平均Dice相似系数(DSC)衡量)方面的差异;(b) 传统弱监督配准方法使用强度特征和Dice损失进行配准学习;© 分割特征辅助配准框架将语义特征视为辅助信息以增强强度特征进行形变预测,并由Dice损失监督;(d) 本方法的整体架构。

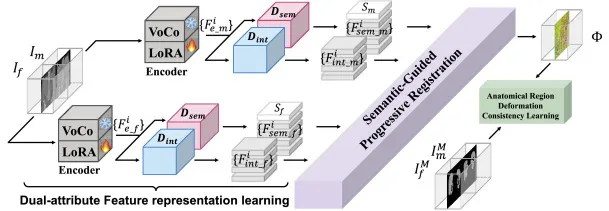

图2. 所提出框架的网络架构示意图。在训练过程中,我们首先利用权重共享的预训练VoCo(通过低秩适应(LoRA)进行微调)从输入移动图像(Im)和固定图像(If)中分别提取编码特征{Fe_mi}和{Fe_fi}。特征解码包含双解码器:一个语义解码器(Dsem)和一个强度解码器(Dint),它们分别处理编码特征以生成语义和强度特征表示。这些多级特征随后被整合到语义引导的渐进式配准过程中,以估计形变场Φ。通过使用预测的形变场Φ对移动图像Im进行形变,得到最终的配准图像Iw。为了提高目标解剖区域内的配准精度,我们提出了一种新颖的解剖区域形变一致性学习策略。在该策略中,输入图像的掩膜版本(ImM和IfM)首先通过相同的网络架构进行处理。然后,施加一致性约束以提高配准精度。每个关键组件的详细信息将在下面介绍。

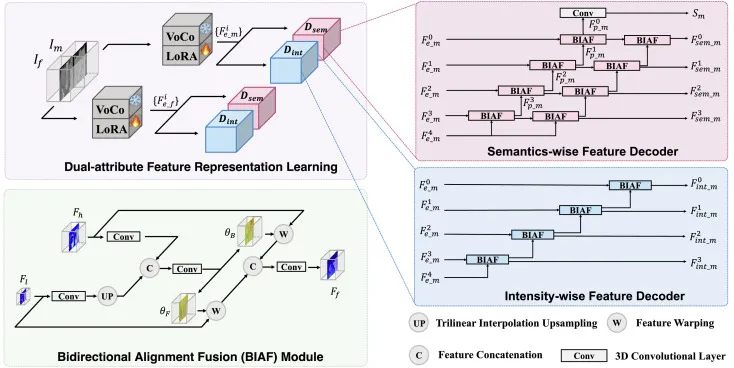

图3. 双属性特征表示学习框架示意图。LoRA微调的VoCo从输入图像对中提取多尺度特征表示Fe_m和Fe_f。这些特征随后通过双解码器架构进行处理,该架构包括语义解码器Dsem和强度解码器Dint。两个解码器都包含了我们提出的BIAF模块,该模块在多分辨率框架内实现精确的跨尺度特征融合。Dsem生成语义特征(Fsem_m, Fsem_f),而Dint生成强度特征(Fint_m, Fint_f),共同形成用于精确配准的综合特征表示。

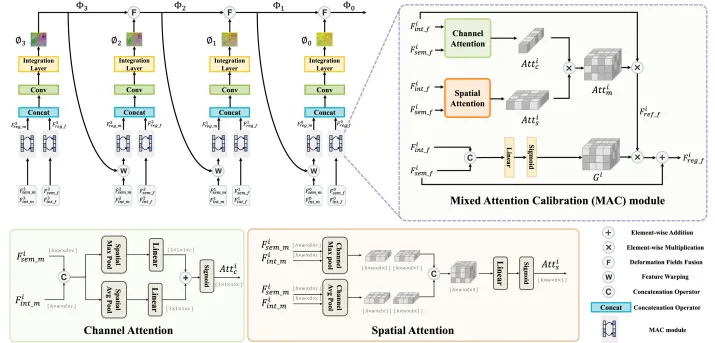

图4. 所提出的语义引导渐进式配准示意图,该配准从最低分辨率级别开始分层操作。在每个分辨率级别i,语义特征(Fsem_m,Fsem_f)和强度特征(Fint_m,Fint_f)通过MAC模块处理,生成精炼特征(Freg_m,Freg_f)。然后利用这些增强特征估计残差形变场Ï•i,并将其与前一分辨率级别累积的形变场Φi+1融合,以估计当前分辨率级别的Φi。复合形变场引导移动图像特征在后续分辨率级别上的形变。这种渐进式细化一直持续到最高分辨率级别,其中计算最终形变场Φ,实现精确配准。

图5. 所提出的解剖区域形变一致性学习策略示意图。原始图像对及其解剖掩膜变体通过权重共享网络处理,以生成相应的形变场Φ和ΦM。通过分别使用Φ和ΦM对ImM进行形变而得到的图像IwO和IwM之间计算一致性损失。

图6. 本方法(Ours)与OASIS数据集中两个病例的其他竞争方法的定性比较。对于每个病例,比较结果按不同方法分为三行。顶部:形变后的移动图像;中部:形变后的移动图像分割标签;底部:每种方法获得的形变场可视化。

图7. OASIS数据集上不同配准方法结果的详细分析。(a) 箱线图显示了不同方法在四种解剖结构(脑脊液 (CSF)、灰质 (GM)、白质 (WM) 和皮质 (CORT))上的DSC性能,以及整体DSC性能。(b) 按器官的散点图,比较了本方法与第二优方法(NICE-Trans)。X轴表示NICE-Trans的DSC(%)性能,Y轴表示本方法(Ours)的DSC(%)性能。虚线对角线表示相等(y = x),线上方的点表示本方法优于NICE-Trans。

图8. 本方法(Ours)与腹部数据集中两个病例的其他竞争方法的定性比较。对于每个病例和每种方法,比较结果分两行呈现:第一行显示形变后的移动图像及其对应的形变分割标签叠加图,第二行可视化估计的形变场。

图9. 腹部数据集上不同配准方法结果的详细分析。(a) 箱线图显示了不同方法在四种解剖结构(肝脏、脾脏、右肾和左肾)上的DSC性能,以及整体DSC性能。(b) 按器官的散点图,比较了本方法与第二优方法(RDP)。X轴表示RDP的DSC(%)性能,Y轴表示本方法(Ours)的DSC(%)性能。虚线对角线表示相等(y = x),线上方的点表示本方法优于RDP。

图10. 本方法(Ours)与髋关节数据集中两个病例的其他竞争方法的定性比较。对于每个病例和每种方法,比较结果分两行呈现:第一行显示形变后的移动图像及其对应的形变分割标签叠加图,第二行可视化估计的形变场。

图11. 髋关节数据集上不同配准方法结果的详细分析。(a) 箱线图显示了不同方法在三种解剖结构(骨盆、右股骨和左股骨)上的DSC性能,以及整体DSC性能。(b) 按器官的散点图,比较了本方法与第二优方法(GroupMorph)。X轴表示GroupMorph的DSC(%)性能,Y轴表示本方法(Ours)的DSC(%)性能。虚线对角线表示相等(y = x),线上方的点表示本方法优于GroupMorph。

图12. 所提出方法在OASIS数据集 (a)、腹部数据集 (b) 和髋关节数据集 © 上有无(w/)和无(w/o)BIAF模块时的学习曲线。

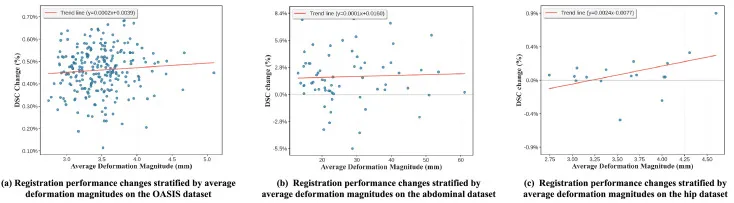

图13. 引入BIAF模块在不同形变幅度样本上性能变化的层次分析。(a) 在OASIS数据集上的评估;(b) 在腹部数据集上的评估;© 在髋关节数据集上的评估。每个点代表一个测试样本。X轴表示平均形变幅度,通过计算形变场中对应区域器官掩膜的平均形变幅度(来自真实二值分割标签)获得。Y轴报告引入BIAF模块后产生的DSC变化。每个子图的红色实线是最小二乘拟合线,表示DSC变化与平均形变幅度之间的趋势。

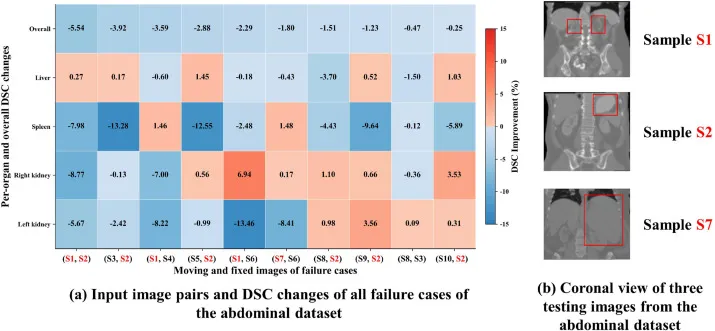

图14. 失败病例的详细分析。(a) 腹部数据集所有失败病例的输入图像对和DSC变化;(b) 腹部数据集中三个测试图像的冠状视图。顶部:样本S1包含双侧肾萎缩(红色包围盒);中部:样本S2在脾脏上方有一个异常肿块(红色包围盒),可能使脾脏移出正常位置;底部:样本S7有一个异常脾脏(红色包围盒),可能使左肾移出正常位置。

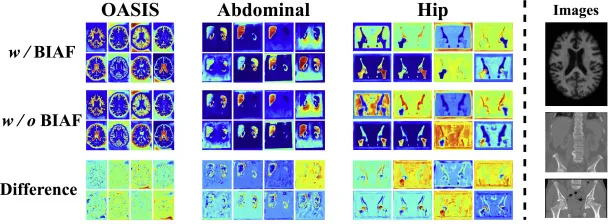

图15. 在最高分辨率下固定图像的语义特征图Fsem_f0的可视化,这些特征图由引入(w/)和未引入(w/o)BIAF模块的所提出方法学习得到。这里显示了8个随机选择的特征通道。顶部:由引入BIAF模块的所提出方法学习到的特征图;中部:由未引入BIAF模块的所提出方法学习到的特征图;底部:顶部和中部特征图之间逐元素相减得到的差异图,突出显示了引入BIAF模块对特征表示学习的影响。

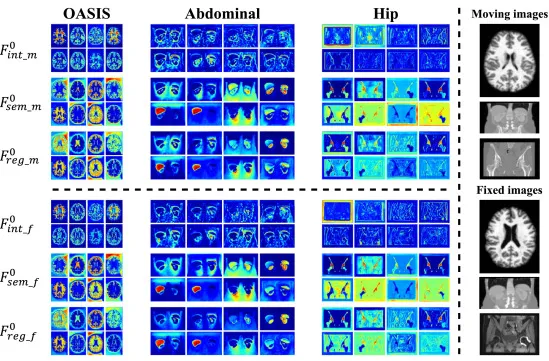

图16. MAC模块在最高分辨率下,移动图像(顶部)和固定图像(底部)的输入和输出特征图的8个随机选择通道的可视化,其中Fint_m0和Fint_f0是输入的强度特征;Fsem_m0和Fsem_f0是输入的语义特征;Freg_m0和Freg_f0是MAC模块校准后的输出特征。

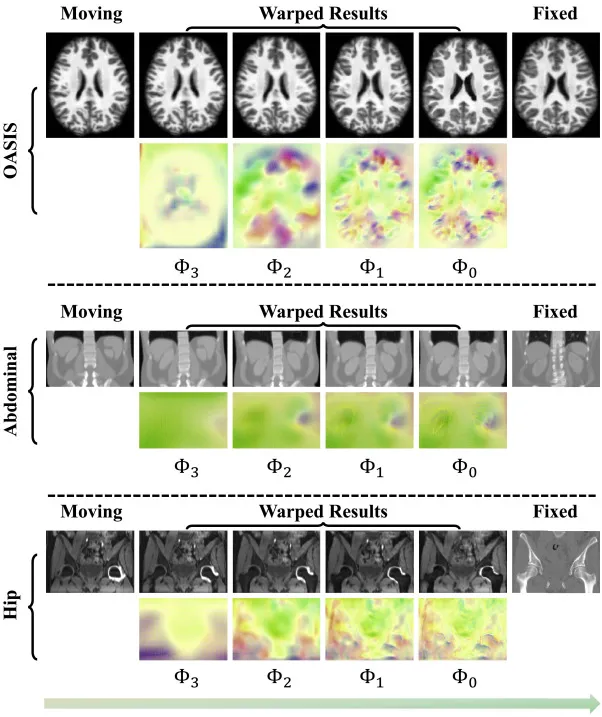

图17. 所提出方法渐进式配准过程的定性分析结果。这里显示了来自每个数据集的输入图像对,以及在不同分辨率级别生成的形变场(Φ3、Φ2、Φ1和Φ0)和相应的形变图像。在每个级别,形变场都被上采样到与原始图像相同的分辨率,然后用于形变移动图像以进行可视化。